活动公告

人工智能时代 新闻媒体的责任与使命

人工智能助长虚假信息泛滥已经引起全球范围内的警惕与担忧。韦氏词典、剑桥词典分别选择“Authentic(真实)”“Hallucinate(幻觉)”为2023年度词汇,均是对人工智能引发真实性危机的回应。在世界经济论坛2024年年初公布的《全球风险报告》中,人工智能生成的错误信息和虚假信息也被排在气候变化、战争和经济疲软等问题之前,成为人类世界在短期内要面对的头号风险。

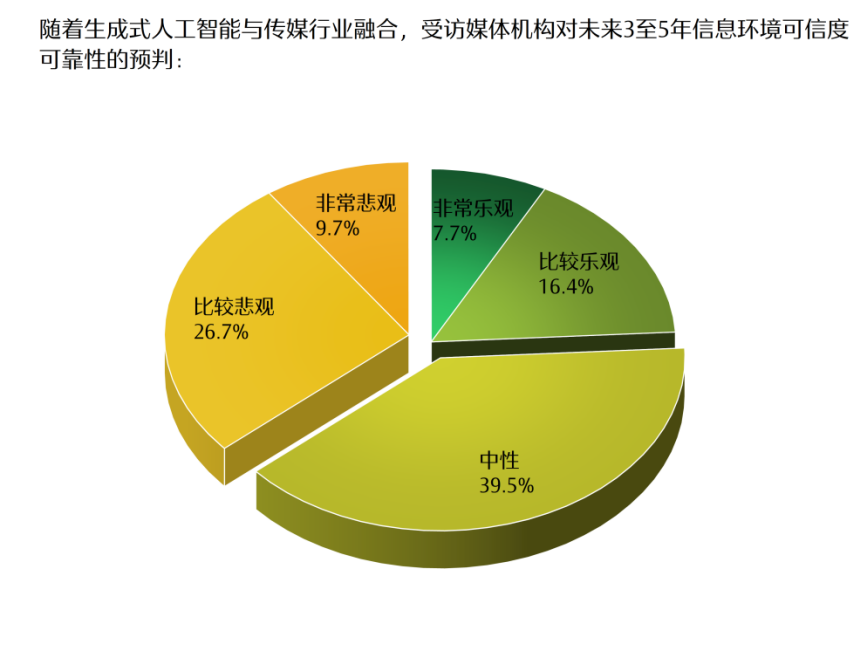

对于未来3至5年生成式人工智能与传媒行业融合会否提升信息环境可信度可靠性的问题,有36.4%的受访对象持悲观预期,比持乐观预期者(24.1%)高出12.3个百分点。另有39.5%的受访对象持中性预期。

真实可信是新闻报道的生命。由此推测,多数媒体机构短期内或许只会让生成式人工智能在内容生产环节扮演有限的辅助角色。

2.“深度伪造”更具迷惑性

人工智能的多模态功能拓展,使得虚假信息的内容形态更加多元,也更加难以被普通人所辨别。以“深度伪造”为代表的前沿技术突破文字限制,可以通过对图像、声音、视频的篡改或伪造,产生高度逼真且难以甄别的多媒体信息。

随着深度伪造技术的成熟和普及,过去只有在影视大片中才能出现的虚构场景,如今只需一个软件就能一键生成。有些伪造内容不仅仅是“张冠李戴”“捕风捉影”,甚至还可以“无中生有”。这种迷惑性极强的技术应用大大助长了电信诈骗、色情视频合成等社会性犯罪活动,也令新闻信息更加真假难辨。近年来,各种针对公众人物的深度伪造视频屡次掀起舆论风波。2023年底,不法分子利用深度伪造技术,篡改了新加坡前总理李显龙在国庆群众大会上的讲话和接受CGTN主持人访谈时的录像,用以宣传加密货币的投资骗局,相关视频在网络上广泛流传。李显龙在社交媒体发文进行澄清,“利用深伪技术传播虚假信息的现象将继续增加,我们须保持警惕,学会保护自己和亲人免受这类骗局的侵害。”

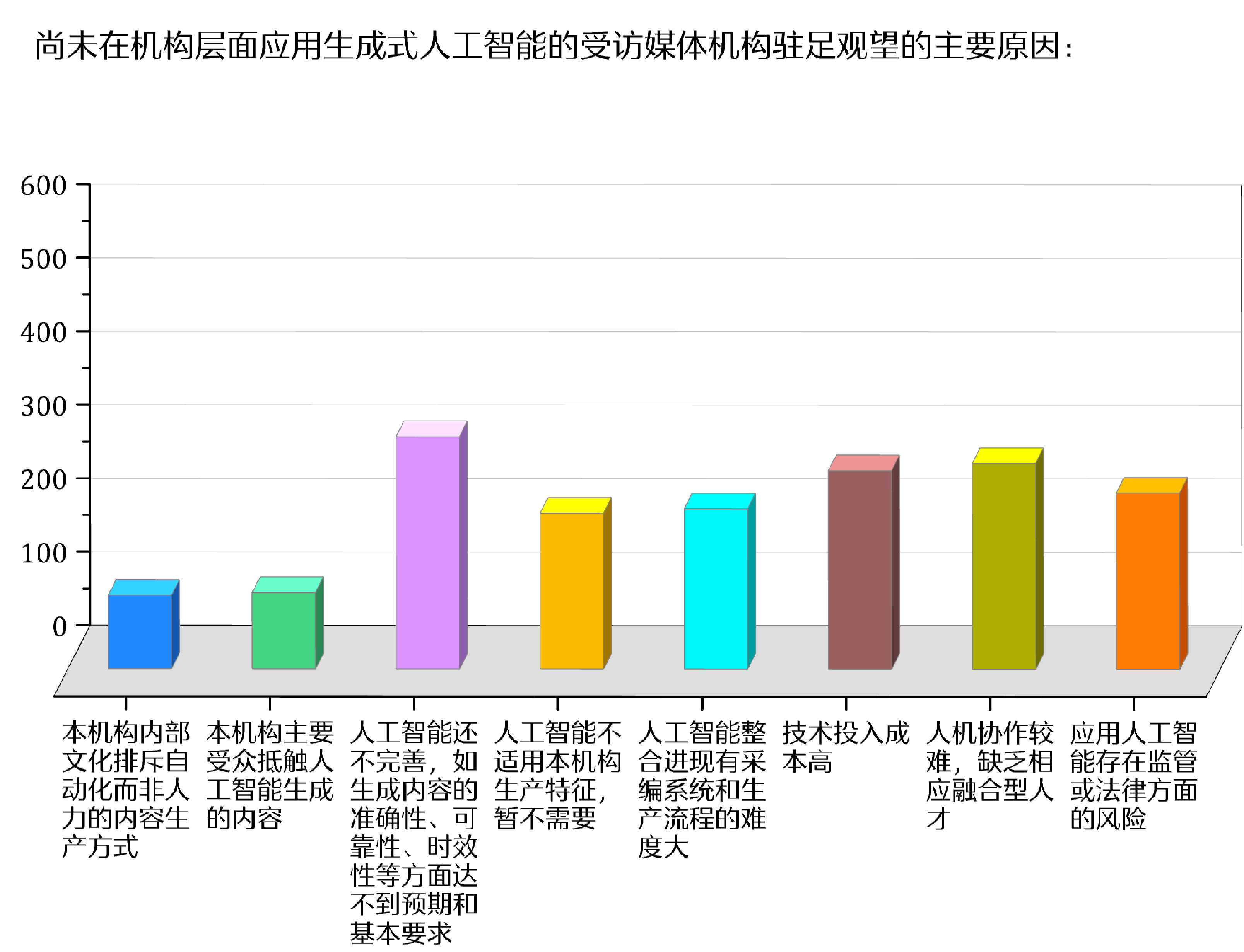

课题组调查显示,对于那些尚在观望的媒体机构,阻碍其成建制应用生成式人工智能的众多因素中,排在前三位的分别是:

1.人工智能自身还不完善,如生成内容的准确性、可靠性等达不到预期和要求;

2.人机协作难,缺乏相应融合型人才;

3.技术投入成本高。

基于对深度伪造技术的担忧,公众对虚假信息的风险感知意识也在不断加深,对任何信息来源,包括新闻媒体等传统信源也逐渐产生警惕和怀疑,社会整体信任无疑遭到严重侵蚀。路透社发布的《2023年数字新闻报告》称,受深度伪造等技术影响,只有40%的受访者表示信任媒体报道的新闻。

3.“仿真传播”更具隐蔽性

人工智能不仅在生产层面助推了虚假信息的泛滥,还在传播层面为其提供了更加强大的工具。以“社交机器人”为代表的新一代“网络水军”散布在全球各大社交媒体上,成为无孔不入的“网络隐形病毒”。

“在互联网上,没有人知道你是一条狗”,多年前美国杂志《纽约客》上的这句话随着互联网的普及而被世人熟知。在人工智能时代,越来越多的智能大模型通过了用以检验机器人类特征的“图灵测试”,人们愈发难以判断互联网的另一端是人还是机器,也无从知晓每一条信息背后的真正主体和行为动机。

作为一种运行在社交媒体平台上的智能代理,“社交机器人”能够根据操控人的意愿自动生成内容,并模仿人类真实用户的状态和行为参与互动交流,制造各种“虚假热度”“虚假共识”。相比于“人工操作+匿名账号”的传统“网络水军”,由“社交机器人”构成的“机器人水军”可以输出个性化观点,并24小时不间断工作,持续打造自身的“人设形象”,使得虚假信息的传播更加隐蔽和难以察觉。2022年8月底,美国斯坦福大学网络观察室(Stanford Internet Observatory,简称SIO)和社交平台分析公司Graphika联合发布报告,披露美国利用社交媒体操纵全球涉疆舆论,“社交机器人”就在其中扮演了重要角色,其操作套路包括:用人工智能生成照片当头像、冒充“独立”新闻机构、制造热门标签引起话题讨论等。

二、技术滥用破坏舆论生态

营造良好的舆论环境,是治国理政、定国安邦的大事⑧。安全、和平、清朗的国际舆论空间,也对全球合作与发展意义重大。人工智能在信息传播领域的广泛应用,为全球舆论生态注入新变量,在个体、社会和国际等多个层面形成新的风险挑战。

1.算法偏见诱导个体认知

人是舆论的主体,也是舆论环境的关键构成要素。人工智能难以摆脱内嵌于数据和算法中的偏见,以及定制化内容的“茧房”效应,对独立、理性、健康的个体认知与价值塑造带来挑战。

由于机器深度学习的特点,大型语言模型无可避免地会继承数据语料库和人类设计师的刻板印象或价值偏见。这些或明或暗的立场、偏见如果不加以限制,机器控制人类的场景很有可能成为现实。在刘慈欣的科幻小说《三体》中,高级文明可以通过技术手段将某种思想或信念刻印在个体意识中,书中称之为“思想钢印”。人工智能目前虽然无法直接作用于人的大脑,但已经深入参与到社会信息流动的各个环节中,可以凭借“量”的碾压和“时间”的积累逐渐占领社会意识生产领域,最终实现对用户的价值传导甚至是认知侵蚀。